ビジネスメディアのBeyondにて「xR(AR、VR、MR)の「ビジネス活用」最前線」というお題で全4回にわたりインタビュー記事を掲載していただきました。

- xR(AR、VR、MR)の「ビジネス活用」最前線 | Beyond(ビヨンド)

- ファーストラインワーカーの働き方改革は、xR(AR、VR、MR)で加速する | Beyond(ビヨンド)

- xR(AR、VR、MR)が起こす「現場の技術伝承」革命 | Beyond(ビヨンド)

- xR(AR、VR、MR)導入がもたらす「付加価値」と未来予測 | Beyond(ビヨンド)

一応会社ブログにはリンクだけまとめたんですが、個人的な思いというか考えてることは切り離した方がいいかなと思い、こちらにもまとめます。

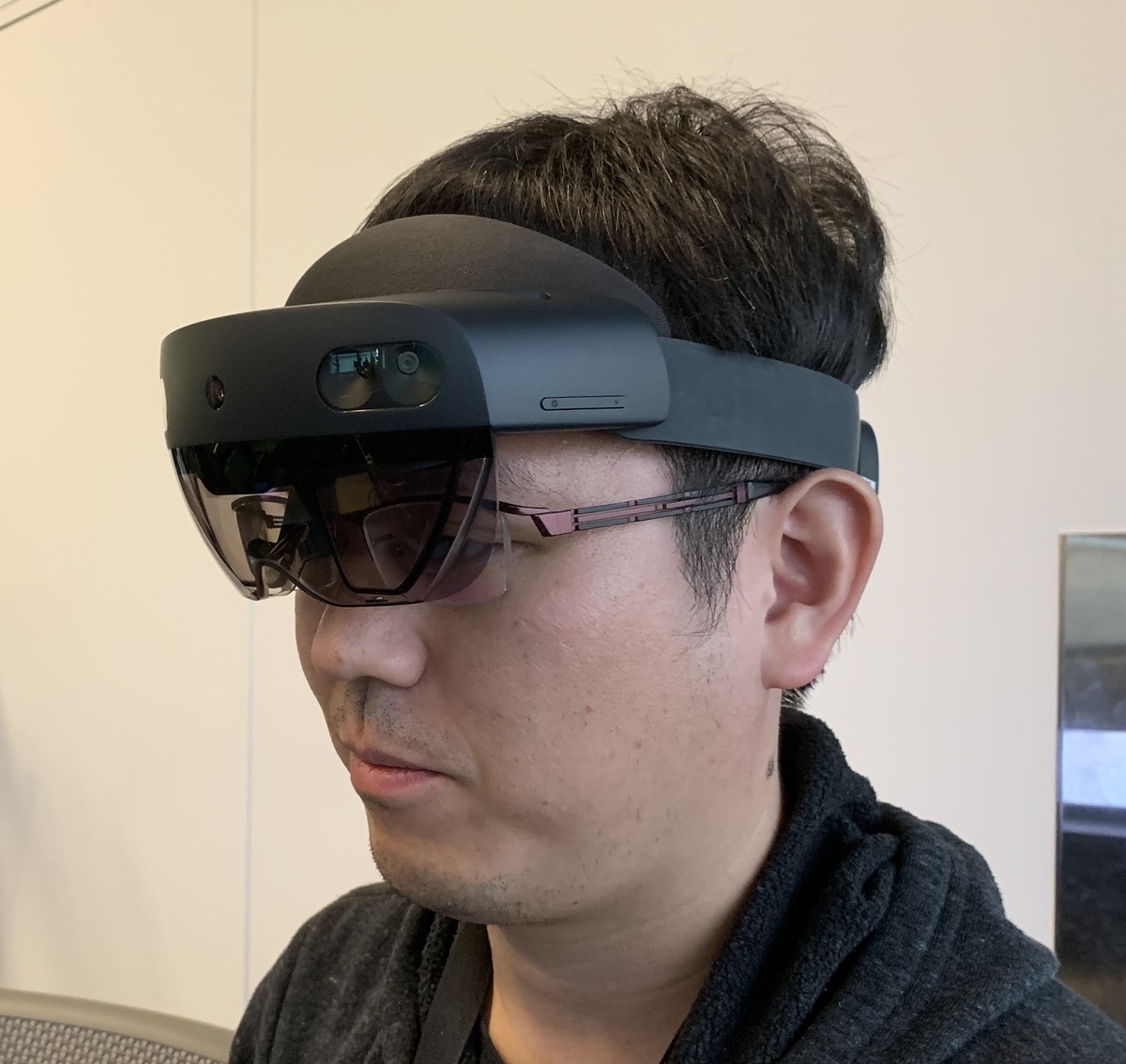

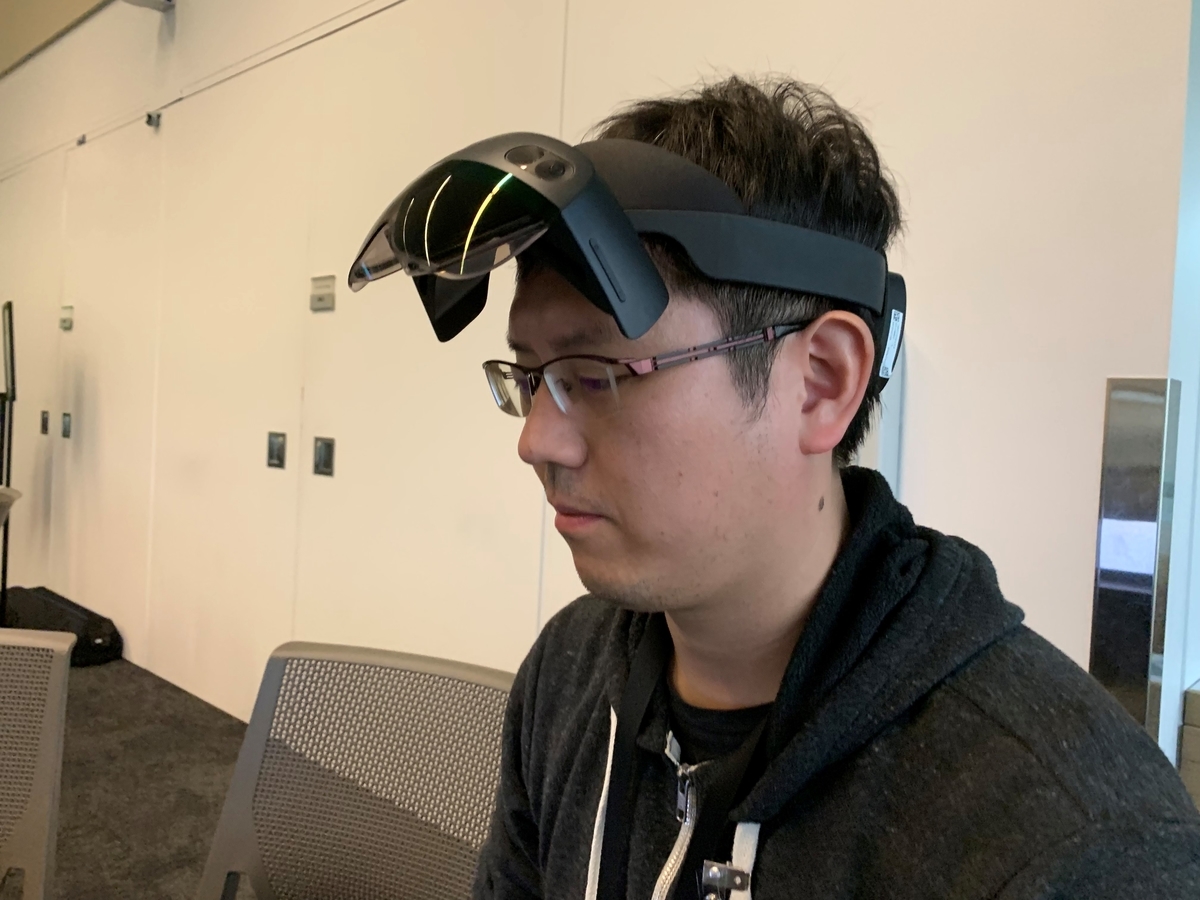

HoloLens の業務利用の現状

第一回で「実際の導入を見据えた案件も少しずつ出始めています」としていますが、これはホロラボでの開発期間、契約期間からも実感しています。

2018年は長くても半年くらいのプロジェクトがいくつかでしたが、2019年は1年分の予算を確保していただき開発や調査にそれだけのコスト(時間、費用)をかける企業が増えてきました。プロジェクトはEnvisioning(導入) → PoC(概念実証) → Pilot(部分導入) →Deploy(実導入)と進んでいき、Pilot以降を見据えた取り組みが増えてきています。

去年あたりから、プロジェクト数の数字などを出すようにしています。これは外からあまり見えない実態みたいなものを出していきたいという気持ちがあります。HoloLensはいろいろなところで使われ始めています。とはいってもどのくらいの会社が使ってるの? どのくらいのプロジェクトが回ってるの?という数字が見えたほうがイメージしやすいのではと思っています。

例えば2018年の数字的なところはこちらです。2019年上半期もまとめてもらったので、どこかで出せるといいとは思ってるのですが、なかなか機会がなく。単純な数字でいうと、2019年半分で2018年一年分くらいにはなってます(プロジェクト数、売り上げなど)。

目的と手段

HoloLensの導入は手段であって目的ではありません。目的は業務の効率化であり、業務の効率化は線であって点ではありません。第二回で「自社の業務について「めちゃめちゃ考える」こと」と入れていますが、お客さん自身が自分たちの業務を考えること自体に意味があると感じています。実際にボトルネックはどこなのか?それはHoloLensでなければ解決できないのか?

MRPPのトレーニングで最初に言われたことは「Why? HoloLens?」でした。これは「なぜHoloLensでなければならないのか?」、「HoloLens以外の方法が最適ではないのか?」という問いに答えられるようにしなさいということです。これをお客さんとの会話の中で見つけ出さないといけません。なので、お客さんとの会話は大切で、もしHoloLens以外が最適であれば、HoloLens以外を選択するという提案をすることもあります。あくまでもぼくらの仕事はお客さんの業務の課題の解決なので。

業務課題の解決という意味では、点で見るとHoloLensが最適でも線で見るとHoloLens以外が最適なケースも往々にしてあります。ある業務ではHoloLensを使って改善ができるとしても、よくよくワークフローで話を聞くと、その前工程が実はボトルネックで、そこにはHoloLens以外の解決手段が適している場合があります。

なので仕様含めて丸投げされる場合は非常に厳しいですし効果も出にくいと考えています(これはHoloLensに限らないですが)。ぼくらは技術の提供はできますが、業務プロセスに関しては素人なので、そこはお客さん側でやってもらうこと。それをベースに技術的に解決することが自分たちの仕事と思っています。

とはいえ、多くのお客さんと話していると、課題は似ていたり、やりたいことが似ていることは多く、そういう共通項を見つけやすいことがお客さんと接している時間が長いことのメリットかなと思っています。

文化的な解決

最近ちょっと考えてるのが、デジタルトランスフォーメーションだったり出社だったりというのは、技術ではなく文化(気持ち)の面が大きく作用するのかなと思っています。

たとえばデジタルトランスフォーメーションで紙をなくすといった場合に、いままで紙でやり取りしていたものが一切なくなるとして、それで業務が回るのか?という心配が変化を阻害するのではないかと思っています。

人間は変化を恐れるものなので、先に不安があると変化しない方を選択します。であれば、技術的な解決と並行して、心理的な不安を取り除くというなことも必要なんだろうなとぼんやり考えています。それをしないと表面上の導入に過ぎず、時間が経つともとに戻ってしまい、本当の意味での変革にはならないと思っています。

VRデバイスの有効性

第三回にもありますが、個人的には今ビジネス向けVRをやりたいと思っています(諸々のリソースの関係でなかなか難しいのですが)。自分の中では昨今のスタンドアロンVRをVRとして見ていない節があり、HoloLensと同列に考えています。HoloLens、Mirage Solo、Oculus Go、Oculus Quest、それぞれ、性能、値段、機能によってメリット、デメリットがあり、それぞれ排他ではなく選択肢として考えると自分の中ではすっと入ってきたりします。HoloLens 2になり性能も似たようになったので性能的なひっかかりは少なくなると考えています。そういう意味ではWindows MR Immersiveのスタンドアロンが出てくれることを期待していたりします。

HoloLensは光学シースルーデバイスとして高性能ではありますが値段が高いことがとにかくネックになる。それに対してOculus Go、Oculus Questは10分の1程度に収まる。HoloLensでやっていることが必ずしもHoloLensでなくても良くてOculus Go、Oculus Questでも問題ない場合、単純にデバイス量で10倍は見込めます(ソフトウェアの費用は入れていませんが、そこは全体で調整すればいいのかなと思っています)。

第一回にある「米ウォルマートが従業員向けのVRトレーニングでOculus Goを17,000台購入」というのがありますが、ここまではいかなくてもまとまった台数の導入というのは非現実的なものではないかなと思っています。